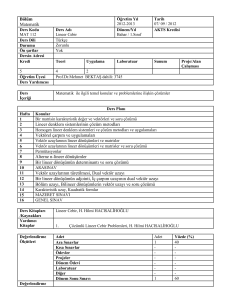

HATIRLATMALAR

MATRĐSLER ĐÇĐN GENELLEŞTĐRĐLMĐŞ ĐNVERS KAVRAMI

A: n × m matrisi için AA − A = A özelliğini sağlayan A − : m × n matrisine A nın

g-inversi denir. Bir matrisin sonsuz tane g-inversi vardır. A regüler ise A − = A −1 dır.

Ax = g denklem sistemini göz önüne alalım.

a) Denklem sisteminin tutarlı olması için gerek ve yeter şart

AA − g = g

olmasıdır. (Burada A − , A nın bir g-inversidir.)

b) Denklem sistemi tutarlı olsun. x 0 = G g nin bir çözüm olması için gerek ve

yeter şart G matrisinin A nın bir g-inversi olmasıdır.

c) Denklem sistemi tutarlı olsun. z isteksel bir vektör olmak üzere,

x = A − g + ( I − A − A) z

denklem sisteminin bir çözümüdür.

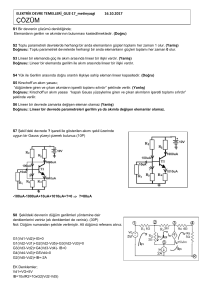

Örnek:

Yij = µ + α i + ε ij , i = 1, 2 , j = 1, 2 , 3

LMY11 OP LM1

MMY12 PP MM1

MMYY1321 PP = MM11

MMY22 PP MM1

N 23 Q N1

modelinde,

OP

PL µ O

0P M P

P α1 + ε

1P M P

MNα2 PQ

1P

P

1Q

1 0

1 0

1

0

0

0

LM1

MM1

1

X =M

MM1

MN11

ve

OP

P

0P

P

1P

1P

P

1Q

1 0

1 0

1

0

0

0

,

LM µ OP

β = M α1 P

MNα2 PQ

X ' X β = X 'Y

normal denklemler,

6 3 3 µˆ Y..

3 3 0 αˆ1 = Y1.

3 0 3 αˆ Y

2 2.

2

3

3

3

j =1

j =1

Y.. = ∑ ∑ Yij , Y1. = ∑ Y1 j , Y2 . = ∑ Y2 j

i =1 j =1

olmak üzere, katsayılar matrisinin rankı 2 dir. Tutarlı olan bu denklem sisteminin

birden çok (sonsuz) çözümü vardır.

6 3 3

X ' X = 3 3 0

3 0 3

matrisi için

6 3 3 0 0

0 6 3 3 6 3 3

3 3 0 0 1/ 3 0 3 3 0 = 3 3 0

3 0 3 0 0 1/ 3 3 0 3 3 0 3

olmak üzere,

matrisi, X ' X

6 3

3 3

3 0

olmak üzere,

0 0

0

( X ' X )1− = 0 1/ 3 0

0 0 1/ 3

matrisinin bir g-inversidir.

3 1/ 6

0

0 6 3 3 6 3 3

0 −1/ 6 1/ 3 0 3 3 0 = 3 3 0

3 −1/ 6 0 1/ 3 3 0 3 3 0 3

1/ 6

0

0

( X ' X )−2 = −1/ 6 1/ 3 0

−1/ 6 0 1/ 3

matrisi de X ' X matrisinin bir g-inversidir. Bu iki g-invers yardımıyla,

µˆ

0 0

0 Y.. 0

−

αˆ1 = ( X ' X )1 X ' Y = 0 1/ 3 0 Y1. = 1/ 3Y1.

αˆ

0 0 1/ 3 Y 1/ 3Y

2.

2 1

2.

µˆ

1/ 6

0

0 Y..

1/ 6Y..

−

αˆ1 = ( X ' X )1 X ' Y = −1/ 6 1/ 3 0 Y1. = 1/ 3Y1. −1/ 6Y..

αˆ

−1/ 6 0 1/ 3 Y 1/ 3Y −1/ 6Y

2.

..

2 2

2.

gibi farklı iki çözüm elde edilebilir.

LM6OP

λ = M3 P

MN3PQ

için

µˆ

µˆ

λ ' αˆ1 = λ ' αˆ1 = Y1. + Y2.

αˆ

αˆ

2 1

2 2

dır.

y ∈ Rn , X :n × p

olmak

üzere

Y = Xβ +ε

lineer

modelinde

X ′X β = X ′ y normal denklemlerin bir çözümü β̂ olmak üzere λ ' βˆ lineer

bileşiminin (sayısının) bir tek olması için gerek ve yeter şart

λ ' = λ ' ( X ′X ) − X ′X

olmasıdır.

λ: p × 1 vektörünün X : n × p matrisinin satır vektörlerinin

gerdiği uzayda

olması (yani λ ' = c ' X , ∃c ∈ R n ) için gerek ve yeter şart λ ' = λ ' ( X ′X ) − X ′X

olmasıdır.

*********

∀X : n × p matrisi için,

1) XX + X = X

2) X + XX + = X *

3) XX + simetrik

4) X + X simetrik

koşullarını sağlayan bir tek X + matrisi vardır. Bu matrise X matrisinin MoorePenrose genelleştirilmiş inversi denir.

X ∈ R n × p , y ∈ R n olmak üzere Euclide normunda,

min y − X β = min( y − X β )′( y − X β )

β

β

problemin çözümü,

min y − X β = y − XX + y

β

Normal Dağılım

Σ : n × n tipinde pozitif tanımlı simetrik matris, µ ∈ R n×1 bir vektör olmak

üzere bir Y rasgele vektörün olasılık yoğunluk fonksiyonu

f ( y1 , y2 ,..., yn ) =

1

−

( y − µ ) ′ Σ −1 ( y − µ )

, − ∞ < yi < ∞ , i = 1, 2 ,..., n

( 2 π ) det ( Σ )

oiçiminde olduğunda Y ‘ye normal dağılıma sahiptir denir ve Y ∼ N (µ, Σ) biçiminde

e

n

2

gösterilir. Normal dağılımın moment çıkaran fonksiyonu,

MY ( t ) = e

dır.

1

2

µ ′ t + ( t ′Σ t )

Y ∼ N ( µ , Σ ) olmak üzere Y nin lineer dönüşümü olan, AY + b

rasgele vektörü de normal dağılıma sahiptir, yani

AY + b ∼ N ( Aµ + b, AΣA′)

dır. µ = 0 , Σ = I olması durumunda N ( 0, I ) dağılımına çok değişkenli standart

normal dapılım denir. Y ∼ N ( µ , Σ ) olmak üzere, Σ: n × n varyans-kovaryans matrisinin

Σ −1 invers matrisi kendi özdeğer ve özvektörlerinin oluşturduğu matrisler cinsinden,

d1 0 ⋯ 0

0 d2 ⋯ 0

−1

P′

Σ = P

⋮

⋮

0

0 0 ⋯ d

n

olarak yazılsın ve

−1/ 2

Σ

= P

olsun.

d1

0

⋯

0

d2

⋯

⋮

⋮

0

0

⋯

0

0

P′

0

d n

Z = Σ −1/ 2 ( Y − µ )

dönüşümü sonucu Z rasgele vektörü standart normal dağılıma sahiptir, yani

Z ∼ N ( 0, I )

dır.

Y1

Y2

⋮

Y

Y 1

k

Y n×1 = ... = .... k ×1

Y 2 (n − k )×1

Y

k +1

Yk +2

...

Yn n×1

gösterimler altında,

µ1

µ2

⋮

µ

µ

k

1

µ n×1 = ... = .... k ×1

µk +1

µ 2 (n − k )×1

µk +2

...

µn n×1

Y1 ∼ N ( µ , Σ11)

1

Y 2 ∼ N ( µ , Σ 22 )

2

dır.

Σ −1 =

LM Σ11

N Σ21

OP = LM Σ11−1.2 − Σ11−1.2Σ12Σ22−1 OP

Σ 22 Q M − Σ −1Σ 21Σ −1

N 22 11.2 Σ22−1.1 PQ

−1

−1

−1 O

L

Σ11

− Σ11

Σ12Σ 22

.

2

.1 P

= M −1

−1

−1

−

Σ

Σ

Σ

Σ

MN 22.1 21 11

PQ

22 .1

−1

Σ12

Σ11.2 = Σ11 − Σ12 Σ22 Σ 21

−1

Σ 22.1 = Σ 22 − Σ 21Σ11

Σ12

−1

det( Σ ) = det( Σ11) det( Σ 22 − Σ21Σ11

Σ12 )

−1

= det( Σ22 ) det( Σ11 − Σ12 Σ 22

Σ 21)

olmak üzere,

f (y / y ) =

1

2

1

( 2 π ) k det ( Σ11.2 )

1

− Q

2

e

′ −1

−1

−1

Q = ( y − µ ) − Σ12 Σ22

( y − µ ) Σ11

( y − µ ) − Σ12 Σ22

(y −µ )

.2

1

1

2

2

1

1

2

2

dır. Y 2 = y verildiğinde Y1 in koşullu dağılımına karşılık gelen rasgele vektör

2

Y1/ Y = y ile gösterilirse bu rasgele vektör,

2

2

−1

Y1/ Y = y ∼ N ( µ + Σ12 Σ22

( y − µ ), Σ11.2 )

1

2

2

2

2

dır.

−1

E ( Y1/ Y = y ) = µ + Σ12 Σ 22

(y −µ )

1

2

2

2

2

denklemine regresyon denklemi denir.

Karesel Formların Dağılımları

*Y n ×1 ∼ N ( 0, I ) olması durumunda,

Y ′ Y ∼ χ2

(n)

2

*Y n×1 ∼ N ( 0, σ I ) olması durumunda da,

1 ′

Y Y ∼ χ(2n )

2

σ

*Y n ×1 ∼ N ( 0, Σ ) ( rank( Σ = n) ) olmak üzere,

′

Y Σ−1Y ∼ χ(2n )

*Y ∼ N ( 0, In ) ve An × n reel simetrik rankı r olan bir matris olmak üzere,

Y ′ AY ∼ χ2 ⇔ A2 = A

(r )

dır.

*Y ∼ N ( 0, Σ n × n ) ve rank( Σ ) = n , Bn × n reel simetrik bir matris olmak üzere,

Y ′ BY ∼ χ2 ⇔ ( B Σ )2 = B Σ ve rank( B ) = r

(r )

dır.

*Y ∼ N ( µ , Σ ) , rank( Σ ) = n ve A reel simetrik bir matris olmak üzere,

Y ′ AY ∼ χ 2

1

( r ,λ = µ ′ Aµ )

2

⇔ A Σ idempotent ve rank( A ) = r

dır.

Karesel Formların Beklenen Değeri ve Varyansı

* X n × 1 boyutlu bir rasgele vektör olmak üzere,

E ( X ′ A X ) = tr ACov ( X ) + E ( X ) ′ AE ( X )

dır.

* Cov ( X ) = σ2 I ve E ( X ) = 0 ise

E ( X ′ A X ) = σ2tr ( A)

* X n×1 ∼ N ( µ , Σ ) olmak üzere

a) E ( X ′ A X )( X ′ B X ) = tr ( A Σ ) tr ( B Σ ) + 2 tr ( AB Σ ) + µ′ Aµtr ( B Σ )

LM

N

OP

Q

+ µ ′ Btr ( A Σ ) + µµ′ A ΣB µ + ( µ′ Aµ )′ ( µ′ B µ )

b) Cov ( X ′ A X , X ′ B X ) = 2 tr ( A ΣB Σ ) + 4 µ ′ A ΣB µ

c) Var ( X ′ A X ) = 2 tr ( A Σ )2 + 4 µ ′ A ΣAµ

dır (Graybill (1983), Teorem 10.9.11)

Normal Dağılımlı Rasgele Vektörlerin Karesel Formlarının Dağılımları.

Cochran Teoremi

*Y ∼ N ( µ , Σ n × n ) , rank( Σ ) = n olmak üzere,

AY ile Y ′ BY bağumsız ⇔ A ΣB = 0

dır.

*Y ∼ N ( µ , Σ n × n ) , rank( Σ ) = n olmak üzere,

Y ′ BY ile Y ′CY baðýmsýz⇔ B ΣC = 0

dır.

*(Cohran Teoremi) Y ∼ N ( µ , σ2 In ) A1, A2 ,..., Ak matrisleri simetrik, sırasıyla

n1, n2 ,..., nk ranklı ve A1 + A2 +... + Ak = In , yani

Y ′ Y = Y ′ A Y + Y ′ A Y +... +Y ′ A Y

1

2

k

k

olsun. Eğer ∑ ni = n ise,

i =1

Y ′ A1 Y , Y ′ A2 Y ,..., Y ′ Ak Y karesel formları bağımsız

ve i = 1, 2 ,..., n için,

1 ′

Y Ai Y ∼ χ2

2

σ

( ni ,λi =

1

2 σ2

µ ′ Ai µ )

dır. Tersine, eğer i = 1, 2 ,..., k için,

1

Y ′ A Y karesel formları bağımsız ve

σ

i

2

1

σ

2

Y ′ Ai Y ∼ χ(2r ,λ )

i i

ise

k

ri = ni , i = 1, 2 ,..., k ve ∑ ni = n

i =1

dır.

Cochran Teoremi karesel formların parçalanmasında çok kul-lanışlı bir

n

teoremdir. Bu teoremdeki ∑ ni = n olması şartı, Ai A j = 0 , i ≠ j , i , j = 1, 2 ,..., n

i =1

2

ya da Ai = Ai ,

denktir.

i = 1, 2 ,..., n olması şartlarına denktir. Yani bu üç şart birbirine

LĐNEER MODELLERDE PARAMETRE TAHMĐNĐ

Y = X β + ε modelinde, ε ∼ N (0, σ 2 I n ) , ( rank( X : n × p ) = p ) , parametre

kümesi,

{

}

Ω = ( β , σ2 ): β ∈ R p , σ2 > 0

ve

Y ∼ N ( X β, σ 2 In )

olmak üzere, olabilirlik fonksiyonu

L (β, σ ; Y ) =

2

1

−

1

2

e 2σ

n 2 n/ 2

( 2π ) (σ )

( Y − X β ) ′ (Y − X β )

ve logaritması,

n

n

1

ln L (β , σ2 ; Y ) = − ln( 2 π ) − ln( σ2 ) − 2 (Y − X β)′ (Y − X β)

2

2

2σ

n

n

1

= − ln( 2 π ) − ln( σ 2 ) −

( Y ′ Y − 2Y ′ X β + β ′ X ′X β )

2

2

2

2σ

dır.

∂

1

(ln L (β, σ2 ; Y )) = − 2 ( −2 X ′Y + 2 X ′X β)

∂β

2σ

∂

n

1

2

β

σ

(ln

L

(

,

;

Y

))

=

−

+

(Y − X β)′ (Y − X β)

∂σ2

2 σ2 2 ( σ2 )2

türevlerin sıfıra eşitlenmesiyle elde edilen,

R| X ′X β = X ′Y

S| σ2 = (Y − X β)′(Y − X β)

n

T

denklem sisteminin, normal denklemler ismini taşıyan,

X ′X β = X ′Y

denkleminden,

βɶ = ( X ′X )−1 X ′Y = X + Y (rank ( X ) = p)

βɶ = X + Y +(I -X + X )z , z ∈ R p (rank ( X ) < p )

ve ikinci denklemden,

(Y − X βɶ)′(Y − X βɶ) 1 ′

σɶ 2 =

= Y ( I − XX + ) Y

n

n

elde edilir.

* σˆ 2 =

1

′

Y ( I − XX + )Y , σ2 için yansızlığı düzeltilmiş en çok

n− p

olabilirlik tahmin edicisidir.

* βˆ ∼ N (β , σ 2 ( X ′X )−1 ) dır.

*

(n − p )σˆ 2

∼ χ(2n− p ) dır.

2

σ

* β̂ ve σ̂ 2 bağımsızdır.

βˆ − βi

* i = 1, 2 ,..., p için i

∼ t( n− p ) dır.

σˆ cii

* β̂ ve σ̂ 2 , β ve σ 2 için yeterli istatistiklerdir.

* β̂ ve σ̂ 2 tam istatistiklerdir.

* β ve σ2 nin reel değerli bir fonksiyonu t (β , σ2 ) olsun ve bu fonksiyonun

yansız bir tahmin edicisi var olsun. O zaman β̂ ve σ̂ 2 tam yeterli istatistiklerinin bir

g (βˆ , σˆ 2 ) fonksiyonu vardır öyleki, g (βˆ , σˆ 2 ) de t (β , σ2 ) nin yansız tahmin edicisidir

ve üstelik g (βˆ , σˆ 2 ) tahmin edicisi düzgün olarak minimum varyans yansız tahmin

edicidir (uniformly minimum variance unbiased estimator, UMVUE) (Graybill, 1976).

Lineer Tahmin Edilebilme

Bir parametre (parametrenin bir foksiyonu) için yansız ve lineer (örneklemin

lineer dönüşümü olan) bir tahmin edici varsa bu parametreye (parametrenin

fonksiyonuna) lineer tahmin edilebilir veya kısaca tahmin edilebilir denir.

Y = X β + ε modelinde X : n × p , ( n > p ) matrisinin rankı rank( X ) = p

olduğunda β parametresi lineer tahmin edilebilir, çünkü Y örnekleminin

( X ′X ) −1 X ′Y lineer fonksiyonunun beklenen değeri,

E ( X ′X ) −1 X ′ Y = E ( X ′X ) −1 X ′ ( X β + ε ) = β , ∀ β ∈ R p

dır. Model tam ranklı olmadığında, yani rank( X ) = k < p olduğunda β parametresi

lineer tahmin edilebilir mi? Başka bir ifade ile,

E(CY ) = β , ∀β ∈ R p

olcak şekilde C: p × n matrisi varmıdır? Olduğunu varsayalım. O zaman,

E(CY ) = E C( X β + ε ) = CX β = β

, ∀β ∈ R p

olmalı, yani

CX = I

olmalıdır. Ancak eşitliğin sağ tarafındaki birim matris p × p boyutlu olup rankı p dır.

Sol taraftaki matris için,

rank( CX ) ≤ k < p

dır. Dolayısıyla varsayımımız doğru değildir.

E(CY ) = β , ∀β ∈ R p

olacak şekilde C matrisi yoktur, yani β nın lineer yansız bir tahmin edicisi yoktur. β

parametresi lineer tahmin edilemez olmasına rağmen β nın bazı dönüşümleri tahmin

edilebilir. X β için Y nin kendisi veya X ( X ′X ) −1 X ′ Y birer lineer yansız tahmin

edicidir. Gerçekten,

E (Y ) = X β

E X ( X ′X ) −1 X ′ Y = X ( X ′X ) −1 X ′X β = X β

dır.

Tasarım modellerinde genellikle X matrisinin rankı sütun sayısından düşük

olduğu için tahmin edilebilme sorunu ortaya çıkmaktadır. Örneğin,

Yij = µ + α i + ε ij , i = 1, 2 , j = 1, 2 , 3

LMY11 OP LM1

MMY12 PP MM1

MMYY1321 PP = MM11

MMY22 PP MM1

N 23 Q N1

Modelinde,

LM1

MM1

1

X =M

MM1

MN11

OP

PL µ O

0P M P

P α1 + ε

1P M P

MNα2 PQ

1P

P

1Q

1 0

1 0

1

0

0

0

OP

P

0P

P

1P

1P

P

1Q

1 0

1 0

1

0

0

0

LM µ OP

β = M α1 P

MNα2 PQ

,

X matrisinin rankı 2 dir. β vektörü lineer tahmin edilemez. Normal denklemler,

6 3 3 µˆ Y..

2 3

3

3

3 3 0 αˆ1 = Y1. Y.. = ∑ ∑ Yij , Y1. = ∑ Y1 j , Y2 . = ∑ Y2 j

i =1 j =1

j =1

j =1

3 0 3 αˆ Y

2 2.

olmak üzere X ′X katsayılar matrisinin rankı da 2 dir. Tutarlı olan bu denklem

sisteminin birden çok (sonsuz) çözümü vardır. Ancak β nın bazı λ ' β lineer

bileşimlerinin farklı çözümlerde aldığı değerler aynı kalmaktadır, yani λ ' βˆ değerleri

değişmemektedir. λ ∈ S ( X ) = X ′ , yani λ vektörü X matrisinin satır uzayında

olduğunda λ ' β lar çözümlere göre değişmez kalmaktadır . Örneğin,

LM6OP

λ = M3 P

MN3PQ

λ ' β = 6µ + 3α 1 + 3α 2

,

için λ ' βˆ değeri β̂ çözümlerine göre değişmez kalmaktadır ve,

2

3

2

3

E (1' Y ) = ∑ ∑ E ( Yij ) = ∑ ∑ 6 µ + 3α 1 + 3α 2 = λ ' β

i =1 j =1

i =1 j = 1

olmak üzere λ ' β = 6µ + 3α 1 + 3α 2 lineer bileşimi lineer tahmin edilebilirdir.

β parametre vektörünün λ ' β , λ ∈R p biçimindeki lineer bileşimlerinden

lineer tahmin edilebilir olanlar hangileridir?

Teorem: λ: p × 1 bilinen sabitlerin bir vektörü olmak üzere

λ ' β tahmin edilebilir⇔ λ ' ∈ S ( X ) = S ( X ′X )

dır.

Bu teoremden görüldüğü gibi λ ' β lineer bileşiminin tahmin edilebilir olması

için gerek ve yeter şart λ ′ vektörünün X matrisinin ( X ′X matrisinin) satır uzayında

bulunmasıdır. λ ′ vektörünün, X matrisinin satır uzayında bulunması özelliği

aşağıdaki özelliklerden herhangibirine denktir.

λ ′ ∈ S ( X ) , λ ′ = c′ X , ∃c ∈ Rn ⇒ rank( X ′ , λ ) = rank( X ′ )

⇔ rank( X ′X , λ ) = rank( X ′X )

⇔ λ ′ = λ ′ ( X ′X ) − X ′X

⇔ X ′ ( X ′ ) − λ = λ ( X ′ c = λ denkleminin

çözümünün varlığı)

λ1 ' β , λ 2 ' β ,..., λ q ' β

lar lineer tahmin edilebilir ve λ1, λ 2 ,..., λ q vektörleri lineer

bağımsız ise bu lineer bileşimlere lineer bağımsız tahmin edilebilir fonksiyonlar denir.

Y = X β + ε modelinde rank( X ) = k (k ≤ p < n) ise k tane lineer bağımsız

tahmin edilebilir fonksiyon vardır. βˆ = ( X ′X )− X ′Y olmak üzere, λ ′β tahmin

edilebilir fonksiyonun en iyi lineer yansız (BLU) tahmin edicisi λ ′βˆ dır. σ2 için bir

yansız tahmin edici,

′

Y Y − βˆ ′ X ′Y

2

σˆ =

n−k

2

dır.

ε ∼ N (0, σ I n ) olması durumunda, λ ′β tahmin edilebilir fonksiyonunun

düzgün minimum varyans yansız tahmin edicisi (UMVUE) λ ′βˆ

dır ve

λ ′βˆ ∼ N (λ ′β , σ 2 λ ′( X ′X )− λ ′) dağılımlıdır. σ2 nin düzgün minimum varyans yansız

tahmin edicisi

σˆ 2 =

′

Y Y − βˆ ′ X ′Y

n−k

dır.

ÖRNEK (Bu örnek atlanabilir)

LMY11 OP LM1

MMY12 PP MM1

MMYY1413 PP MM11

MMY21 PP = MM1

MMY22 PP MM1

MMYY23 PP MM11

N 24 Q N

OP L µ O

0P M P

α1

0P M P

P Mα 2 P

1P M P

τ1 + ε

0P M P

P M τ2 P

0P M P

M τ3 P

0P M P

P N τ4 Q

1PQ

1 0 1 0 0 0

1 0 0 1 0

1 0 0 0 1

1 0 0 0 0

0 1 1 0 0

0 1 0 1 0

0 1 0 0 1

0 1 0 0 0

2

ve ε ∼ N ( 0 , σ 2 I ) olmak üzere, ∑ ciαi

i =1

4

, ∑ ci τ j lineer bileşimlerinden hangileri

j =1

tahmin edilebilir ve bunların düzgün en küçük varyanslı yansız tahmin edicileri nedir?

Bu soruyu ele almadan önce lineer tahmin edilebilir fonksiyonlar için bir baz

elde edelim ve baz fonksiyonlarının düzgün en küçük varyanslı yansız tahmin

edicilerini elde edelim. Bu amaçla modeldeki tasarım matrisi X ile gösterilsin ve

β = ( µ , α1, α2 , τ1, τ2 , τ3 , τ4 )′ olsun. Buna göre model,

Y = X β + ε , ε ∼ N ( 0, σ 2 I )

ve rank( X ) = 5 , k = 5, p = 7, n = 7 olmak üzere k < p dır. Model düşük ranklıdır.

Y..

8 4 4 2 2 2 2

Y1.

4 4 0 1 1 1 1

LM

MM

4

M

X ′X = M2

MM2

MM2

N2

0

1

1

1

1

4

1

1

1

1

1

1

0

0

0

1

0

1

0

0

1

0

0

1

0

LM OP

OP

MM PP

PP

1

P0P , X ′Y = MMYY2.1. PP

MMY.2 PP

0P

P0P

Y.3 P

M

MNY.4 PQ

1 PQ

ve normal denklemler (7 tane denklem),

8µˆ + 4αˆ1 + 4αˆ 2 + 2τˆ1 + 2τˆ2 + 2τˆ3 + 2τˆ 4 = Y..

4µˆ + 4αˆ i + τˆ1 + τˆ 2 + τˆ3 + τˆ 4 = Yi. , i = 1, 2

µˆ + αˆ1 + αˆ 2 + 2τˆ j = Y. j , j = 1, 2,3, 4

olmak üzere 5 tane lineer bağımsız parametrik fonksiyon (baz fonksiyonları) X ′X

matrisinin satırlarından 5 tanesini seçerek (örneğin 1,2,4,5,6 veya 1,2,4,5,7 ile)

oluşturulabilir, yada X ′X in satırlarının lineer bileşimi olan lineer bağımsız 5 tane

satır vektörü alınabilir. i = 1, 2 için normal denklemlerin ikinci ve üçüncü denkleminin

( X ′X matrisinin ikinci ve üçüncü satırlarının) farkı alınırsa µˆ , τˆ1 , τˆ 2 , τˆ3 , τˆ 4 terimleri

yok olmaktadır. Benzer şekilde J = 1, 2 , 3, 4 için iki denklemin farkı alınırsa µ , α1, α 2

terimleri yok olmaktadır. Birinci denklemin de gözönüne alınmasıyla, örneğin,

1.satırdan : 8µ + 4α1 + 4α 2 + 2 τ1 + 2 τ2 + 2 τ3 + 2 τ4

2.satır eksi 3. satırdan : 4 α1 − 4α 2

4.satır eksi 5. satırdan : 2 τ1 − 2 τ2

4. satır eksi 6.satırdan : 2 τ1 − 2 τ3

4.satır eksi 7. satırdan : 2 τ1 − 2 τ4

lineer parametrik fonksiyonları bağımsızdır. Bunların düzgün en küçük varyanslı

yansız tahmin edicileri, µˆ , αˆ1 , αˆ 2 , τˆ1 , τˆ 2 , τˆ3 , τˆ 4 normal denklemlerin herhangibir

çözümü olmak üzere, bu çözümlerin µ , α 1 , α 2 , τ 1 , τ 2 , τ 3 , τ 4 ler yerine yazılmasıyla

elde edilir. Ancak buna gerek yoktur. Çünkü,

8µˆ + 4αˆ1 + 4αˆ 2 + 2τˆ1 + 2τˆ2 + 2τˆ3 + 2τˆ 4 = Y..

4αˆ1 − 4αˆ 2 = Y1. − Y2.

2τˆ1 − 2τˆ2 = Y.1 − Y.2

2τˆ1 − 2τˆ3 = Y.1 − Y.3

2τˆ1 − 2τˆ4 = Y.1 − Y.4

dır. Şimdi sorumuza dönelim. Görüldüğü gibi,

2

∑ ciαi = c1α1 + c2α 2

i =1

lineer bileşimi baz fonksiyonları cinsinden, yani baz fonksiyonlarının lineer bileşimi

olarak, 4 α1 − 4α 2 nin k , ( k ∈ R ) katı olarak,

c1α1 + c2α 2 = k ( 4α1 − 4α 2 ) , k ∈ R

biçiminde yazılabilir. Buna göre c1 = − c2 olmalıdır.

4

∑ ci τi lineer bileşimi baz fonksiyonları cinsinden,

j =1

4

∑ ci τi = k1( 2 τ1 − 2 τ2 ) + k2 ( 2 τ1 − 2 τ3 ) + k3 ( 2 τ1 − 2 τ4 )

j =1

( k1 , k 2 , k 3 ∈ R )

biçiminde yazılabilir. Buna göre ∀τ1, τ2 , τ3 , τ4 ∈ R için

c1τ1 + c2τ2 + c3τ3 + c4τ4 = 2 ( k1 + k2 + k3 ) τ1 − 2 k1τ2 − 2 k2τ3 − 2 k3τ4

olmalıdır. Buna göre,

c1 = 2 k1 + 2 k2 + 2 k3

c2 = −2 k1

c2 = −2 k2

c3 = −2 k3

olmalıdır. Bu durumda da c katsayılarının toplamının sıfır olduğuna dikkat ediniz.

4

4

j =1

j =1

∑ ci τi tahmin edilebilir olması için ∑ ci = 0 olmalıdır.

HĐPOTEZ TESTĐ

Y = X β + ε , rank( X : n × p ) = p , ε ∼ N ( 0 , σ2 I )

{

Ω = ( β , σ2 ): β ∈ R p , σ2 ∈ ( 0 , ∞ )

}

ve H , q × p mertebeli, rankı q olan verilmiş bir matris ve h , q × 1 boyutlu verilmiş

bir vektör ve H β = h denklemi tutarlı olmak üzere,

{

ω = ( β , σ2 ): β ∈ R p , σ2 ∈ ( 0 , ∞ ), H β = h

olsun.

H0 : H β = h

H1: H β ≠ h

hipotezleri için olabilirlik oranı test fonksiyonu,

1 , U (Y ) < c

Φ( Y ) =

0 , U (Y ) > c

RS

T

ve olabilirlik oranı,

U (Y ) =

max

L ( β , σ2 ; Y )

max

L ( β , σ2 ; Y )

( β , σ ) ∈ω

2

( β , σ 2 ) ∈Ω

}

olmak üzere, α anlam düzeyinde c ( 0 < c < 1) sabiti,

PH0 (U ( Y ) > c ) = α

olacak şekilde belirlenir. Burada,

−

1

1

( Y − X β )′ ( Y − X β )

2

e 2σ

n 2 n/ 2

( 2π ) (σ )

olabilirlik fonksiyonudur. Problem, U ( Y ) istatistiğinin elde edilmesi ve bununla ilgili

L ( β , σ2 ; Y ) =

bir olasılık dağılımının bulunmasıdır. Bu istatistiğin dağılımını bulmaktansa,

genellikle olabilirlik oranı testlerinde yapıldığı gibi,

n

n− p

−

W (Y ) = U (Y ) 2 −1.

q

dönüşümü sonucu elde edilen W ( Y ) istatistiğinin dağılımı bulunur.

βˆ = X + Y = ( X ′X )−1 X ′Y

σˆ 2 =

Y '( I − XX + )Y (Y − X βˆ )′(Y − X βˆ )

=

n− p

n− p

olmak üzere, H0 hipotezi doğru olduğunda,

−1

(βˆ − β )′ H ′ H ( X ′X )−1 H ′ H (βˆ − β ) n − p

W (Y ) =

.

∼ F( q , n− p )

Y ′( I − XX + )Y

q

dır.

Cov( H βˆ − h) = σ 2 H ( X ′X )−1 H ′

ve Cov( H βˆ − h) nın en çok olabilirlik tahmin edicisinin,

ˆ ( H βˆ − h) = σˆ 2 H ( X ′X )−1 H ′

Cov

olduğu gözönüne alınırsa,

−1

1

ˆ ( H βˆ − h) ( H βˆ − h)

W (Y ) = ( H βˆ − h)′ Cov

q

biçiminde yazılabilir.

H 0 : H β = h (rank ( H ) = q )

2

hipotezi

altındaki

max L(β , σ ; Y ) probleminin çözümü olan σˆ

( β ,σ 2 )∈ω

2

ω

modelde

en çok olabilirlik (yansızlık

düzeltmesi yapılmış) tahmin edicisine bağlı olarak,

(n − p + q)σˆ ω2 − (n − p)σˆ 2 n − p

W (Y ) =

.

∼ F( q ,n− p )

(n − p)σˆ 2

q

yazılabilir.

indirgenmiş

TAM RANKLI OLMAYAN HĐPOTEZ TESTĐ

Modelimiz,

Y = X β + ε , ε ~ N (0 , σ 2 I ) , rank( X : n × p ) = k , ( k < p < n )

olsun. H : q × p , rank( H ) = q olmak üzere H β nın her bileşeni lineer tahmin

edilebilir, yani H β vektörünün bileşenleri q (q ≤ k ) tane lineer tahmin edilebilir

bağımsız fonksiyon olmak üzere,

H0 : H β = 0

H1 : H β ≠ 0

hipotezleri için olabilirlik oranı test fonksiyonu,

−1

( H βˆ )' H ( X ' X )− H ' ( H βˆ ) n − k

.

~F

W (Y ) =

−1

1

( q , n−k ,λ= 2 ( H β )' H ( X ' X )− H ' ( H β )

Y '( I − XX − )Y

q

2σ

biçimindedir.

BĐREYSEL GÜVEN ARALIKLARI

Modelimiz,

Y = X β + ε , ε ∼ N ( 0, σ2 I ) , rank( X : n × p ) = p ( n > p )

ve parametre kümesi,

{

}

Ω = (β, σ2 ): β ∈ R p , σ2 > 0

olmak üzere,

βˆ = ( X ′X )−1 X ′Y ∼ N (β , σ 2 ( X ′X )−1 )

Y '( I − XX + )Y

(n − p )σˆ 2

,

∼ χ(2n− p )

2

n− p

σ

olup, ℓ 'β için 1 − α güven katsayılı alışılmış güven aralığı,

σˆ 2 =

(ℓ ' β − t

1−α / 2; n− p

ˆ

ˆ (ℓ ' βˆ ), ℓ ' βˆ + t

ˆ

Var

1−α / 2; n− p Var ( ℓ ' β )

veya kısaca,

ˆ (ℓ ' βˆ )

ℓ ' βˆ +t1−α / 2;n− p Var

dır.

σ2 parametresi için alışılmış güven aralığı,

(

dır.

(n − p )σˆ 2 (n − p )σˆ 2

,

)

χ12−α / 2;n− p χα2 / 2;n− p

)

W (Y ) istatistiğinde H = I olduğunda,

(βˆ − β )′( X ′X )(βˆ − β )

∼ F( p , n− p )

pσˆ 2

dır.

P(

(βˆ − β )′( X ′X )(βˆ − β )

≤ F(1−α , p ,n− p ) )=1-a

pσˆ 2

olmak üzere,

β : (βˆ − β )′( X ′X )(βˆ − β ) ≤ pσˆ 2 F(1−α , p , n− p ) ⊂ R p

{

}

kümesi R p de bir elipsoiddir. Bu elipsoide β parametre vektörü için 1- a güven

katsayılı güven bölgesi denir. (Elipsoidin biçiminin X ′X in özdeğerlerine abğlı

olduğuna dikkat ediniz.)

EŞ ANLI GÜVEN ARALIKLARI

Y = X β + ε , ε ∼ N ( 0, σ2 I ) , rank( X : n × p ) = p ( n > p )

olsun. H0: H β = h hipotezinin H1: H β ≠ h hipotezine karşılık test edilmesinde test

istatistiği olarak,

W (Y ) =

−1

( H βˆ − h)′ H ( X ′X )−1 H ′ ( H βˆ − h)

qσˆ 2

kullanılır. θ = H β − h olmak üzere hipotezler,

H0: θ = 0

H1: θ ≠ 0

biçiminde yazılsın. Singüler olmayan her Q: q × q matrisi için yukarıdaki hipotezler

ile,

H0: Qθ = 0

H1: Qθ ≠ 0

hipotezleri aynıdır. Dolayısıyla H0: Qθ = 0 , H1: Qθ ≠ 0 hipotezleri esasında θ nın tüm

(sonsuz tane) lineer bileşimlerinin sıfıra eşit olmasının, en az bir tane lineer bileşimin

sıfırdan farklı olmasına karşılık test edilmesidir. W (Y ) test istatistiği ile elde edilecek

güven aralıklarının θ nın tüm lineer bileşimleri için geçerli olacağı beklenir.

Gerçekten,

(ℓ '( H βˆ − h)) 2

−1

−1

ˆ

ˆ

′

′

′

( H β − h) H ( X X ) H ( H β − h) = max

ℓ∈R q \{0} ℓ ' H ( X ′X )−1 H ′ ℓ

olduğu gözönüne alınırsa (Graybill, 1976),

P(

(βˆ − β )′ H ′ H ( X ′X )−1 H ′

P(

1

qσˆ 2

P(

1

qσˆ 2

−1

H (βˆ − β )

≤ F(1−α , q ,n− p ) ) = 1− α

qσˆ 2

(ℓ '( H βˆ − h))2

≤F

max

(1−α , q , n− p ) ) = 1− α

ℓ∈R q \{0} ℓ ' H ( X ′X )−1 H ′ ℓ

(ℓ '( H βˆ − h))2

≤ F(1−α ,q ,n− p ) , her ℓ ∈ R q \ {0}) = 1− α

−1

ℓ ' H ( X ′X ) H ′ ℓ

P(ℓ ' H βˆ − F(1−α,q ,n− p ) qσˆ 2 ℓ ' H ( X ′X )−1 H ′ ℓ ≤ ℓ ' H β ≤ ℓ ' H βˆ + F(1−α,q ,n− p ) qσˆ 2 ℓ ' H ( X ′X )−1 H ′ ℓ , her ℓ ∈ R q \ {0}) = 1− α

ˆ (ℓ ' H βˆ ) = σ 2 ℓ ' H ( X ′X )−1 H ′ ℓ olduğu gözönüne alınırsa ℓ ' H βˆ ların

yazılır. Var

tümü için eş anlı 1 − α güven katsayılı güven aralıkları,

ˆ (ℓ ' H βˆ )

ℓ ' H βˆ + qF1−α ,q ,n− p Var

olur. Uygulamada tüm güven aralıkları yerine sadece ilgilenilen ℓ ler için elde

edilenler gözönüne alınır.

Yukarıdaki eş anlı güven aralıkları ilk olarak Scheff'e tarafından önerilmiştir.

Eş anlı güven aralıkları elde etmek için bireysel güven aralıklarını elde edip

Bonferonni eşitsizliğinden de faydalanılabilir.

Eş anlı güven aralıkları elde etmek için başka bir yol çok değişkenli tdağılımını kullanmaktır.

θˆ = H βˆ ∼ N ( H β , σ 2V ) , V = (vij ) q×q = H ( X ′X )−1 H ′

olmak üzere,

θˆ − θ

1 1

ˆ2

σ v11

θˆ2 − θ2

ℓ = σˆ 2 v22

⋮

θˆq − θq

ˆ2

σ vkk

rasgele vektörünün olasılık yoğunluk fonksiyonu,

q +n− p

Γ(

)

q + n− p

−

1

2

f ( ℓ; q, n − p , R ) =

(1 +

ℓ ′R ℓ ) 2

n− p

n− p

)(det R )1/ 2

π q / 2 ( n − p ) q / 2 Γ(

2

dır. (Graybill,1976). Burada R matrisinin rij elemanları,

rij =

vij

viiv jj

olmak üzere, R matrisi ℓ nin korelasyon matrisidir. Bu dağılıma q , n − p , R

parametreli çok değişkenli t dağılımı denmek üzere ℓ ∼ tq , n− p , R biçiminde gösterilir.

q = 1 için t1,n − p , R ≡ tn − p dır.

c

∫

−c

⋯∫

c

−c

f ( ℓ; q , n − p , R ) d ℓ 1 ⋯ d ℓ q = 1 − α

olacak şekilde belirlenen c sayısı c = t1− α / 2 ; q , n − p , R ile gösterilsin. O zaman,

θˆ − θi

P (−t1−α / 2;q , n− p , R ≤ i

≤ t1−α / 2;q ,n− p , R , i = 1, 2,..., q ) = 1− α

σˆ 2 vii

dır. Bu eş anlı güven aralıklarında t1− α / 2;q ,n − p , R değerlerini hesaplamak sorun

olmaktadır. R yerine I birim matrisi geldiğinde,

t1− α / 2;q ,n − p , R ≤ t1− α / 2;q ,n − p , I

olduğu ispatlanmıştır. Buna göre,

θˆ − θi

P (−t1−α / 2;q , n− p , I ≤ i

≤ t1−α / 2;q , n− p , I , i = 1, 2,..., q ) ≥ 1− α

σˆ 2 vii

yada,

ˆ (θˆ ) ≤ θ ≤ θˆ + t

ˆ ˆ

P(θˆi − t1−α / 2;q ,n− p , I Var

i

i

i

1−α / 2;q , n− p , I Var (θi ) , i = 1, 2,..., q ) ≥ 1− α

yazılabilir. Parametrelerin bazı değerleri için t1− α / 2;q ,n − p , I tablo değerleri Graybill

(1976) da bulunabilir.

Ayrıca,

t1− α / 2;n − p ≤ t1− α / 2;q ,n − p , I ≤ qF1− α ;q ,n − p

olduğu gösterilmiştir.

TAM RANKLI OLMAYAN MODELLERDE GÜVEN ARALIKLARI

Y = X β + ε , ε ∼ N ( 0, σ2 I ) , rank( X : n × p ) = k ( k < p < n )

olsun. ℓ ' β lineer tahmin edilebilir bir fonksiyon olduğunda,

ℓ ' βˆ = ℓ ' X + Y ∼ N (ℓ ' β , σ 2 ℓ '( X ′X )− ℓ )

olmak üzere ℓ ' β için 1− α güven katsayılı bir güven aralığı,

ℓ ' βˆ +t1−α / 2;n−k σˆ 2 ℓ '( X ′X )− ℓ

'

'

'

dır. ℓ1 β , ℓ 2 β ,..., ℓ m β lineer tahmin edilebilir bağımsız fonksiyonlar olmak üzere çok

değişkenli t dağılımına dayalı eş anlı güven aralıkları,

'

' ˆ

ˆ (ℓ ' βˆ ) ≤ ℓ ' β ≤ ℓ ' βˆ + t

ˆ

P(ℓi βˆ − t1−α / 2;m,n−k Var

i

i

i

1−α / 2;m, n−k Var ( ℓ i β ) , i = 1, 2,..., m) ≥ 1− α

biçimindedir.