Hatırlatma

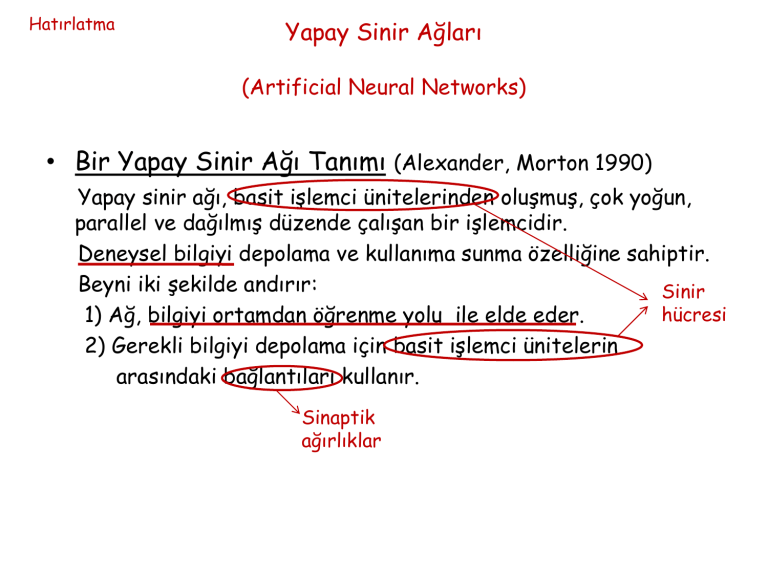

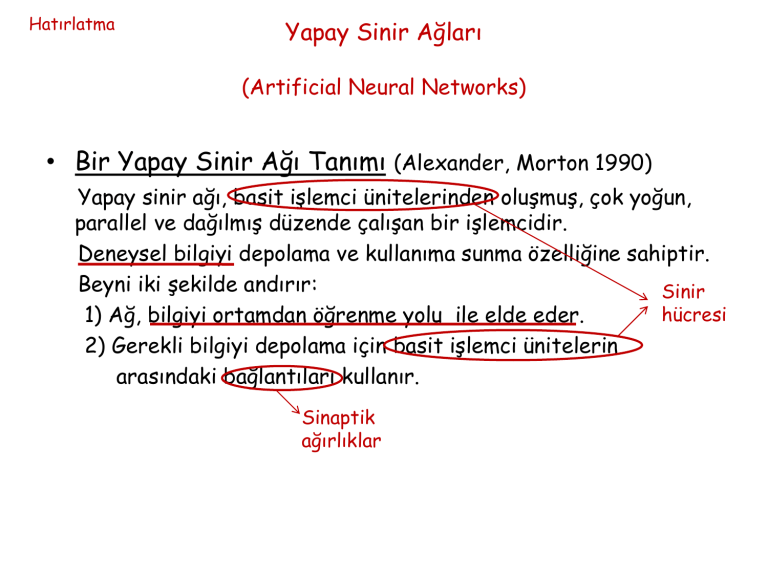

Yapay Sinir Ağları

(Artificial Neural Networks)

• Bir Yapay Sinir Ağı Tanımı (Alexander, Morton 1990)

Yapay sinir ağı, basit işlemci ünitelerinden oluşmuş, çok yoğun,

parallel ve dağılmış düzende çalışan bir işlemcidir.

Deneysel bilgiyi depolama ve kullanıma sunma özelliğine sahiptir.

Beyni iki şekilde andırır:

Sinir

hücresi

1) Ağ, bilgiyi ortamdan öğrenme yolu ile elde eder.

2) Gerekli bilgiyi depolama için basit işlemci ünitelerin

arasındaki bağlantıları kullanır.

Sinaptik

ağırlıklar

Hatırlatma

Öğrenme Süreçleri

Ağın içinde bulunduğu ortamdan etkilenerek parametrelerini

değiştirmesi işlemi öğrenmedir.

Öğrenme şekli,

parametrelerin nasıl değiştirildiği ile belirlenir.

Öğrenme Süreçleri

Eğiticili Öğrenme

Eğiticisiz Öğrenme

Pekiştirmeli

Öğrenme

Özdüzenlemeli

Öğrenme

Hatırlatma

Eğiticili Öğrenme

Ortam

x

Eğitici

yd

+

Eğitilen Sistem

y

e

Hatırlatma

Eğitici ortam hakkında bilgiye sahip

Eğitilen sistem ortam hakkında bilgiye sahip değil

ağırlıklar

Eğitilen sisteme ilişkin .......................

eğitim kümesinde içerilen

hata aracılığı ile değiştiriliyor

bilgi ve ........

Eğiticinin ortam hakkında sahip olduğu bilgi, eğitilen sisteme

aktarılıyor

Burada rahatsız edici bir şey var, ne?

Pekiştirmeli Öğrenme

Eğitilen Sistem

δ

Kritik

Değer Atama

davranış

Ödül r

Ortam

Öğrenme işleminin her adımında istenilen yanıtı sağlayan bir

eğitici yok

Eğitilen sistem, sonuçta elde edilecek yanıta erişmek için

gerekli davranışı eleştiriyi gözönünde tutarak bulmak bulmak

zorunda

Özdüzenlemeli Öğrenme

Ortam

Eğitilen Sistem

Bilgiye sahip ya da eleştiride bulunan bir eğitici yok

Eğitilen sistem girişlerin istatiksel dağılımını belirledikten

sonra sınıflamayı oluşturuyor.

Genlikte Ayrık Algılayıcı-GAA

(Perceptron)

x1

x1

w1

x2 w2

wn

xn

x2 w2

v

y

y

xn

wn+1

1

v w1

w1

1

w2 .... wn wn1

x1

x

2

.

.

.

xn

1

wn

wn+1

v w1x1 w2 x2 ... wn xn wn11

1 v0

y (v )

1 v 0

Ancak Rosenblatt’ın 1954’de

önerdiği yapı bundan farklı

Giriş

Katmanı

x1

x2

w2

w1

Çıkış

Katmanı

x1

1 ( x)

x2

2 ( x)

w1

w2

y

y

xn

1

wn

wn+1

wm

xn

Giriş

Katmanı

m (x)

Birinci

Katman

Çıkış

Katmanı

Bağlantı ağırlıkları,

Sabit ağırlıklar,

eğitim kümesi ile

sabit fonksiyonlar belirlenen tek bir

nöron

Genlikte Ayrık Algılayıcı aslında

• Girişlere doğrudan bağlı tek bir nöron değil

• Birinci katman değişmeyen bir yapıya sahip

• Çıkış katmanı, tek bir nörondan oluşan eğitilebilir

Birinci katmanda farklı

bir yapı.

Peki Rosenblatt neden birinci katmana gerek duymuş?

fonksiyonları oluşturup,

öğrenme ile bunlar cinsinden

çıkışta istenilen fonksiyonu

ifade etmek

Tanım: Doğrusal ayrıştırılabilir küme (Linearly separable set)

X kümesi R tane Xi alt kümesinden oluşsun. gi ‘ler x’in doğrusal

fonksiyonu olmak üzere

g i ( x) g j ( x)

x X i

i 1,2,..., R

j 1,2,...,R

i j

ise Xi kümeleri doğrusal ayrıştırılabilir kümelerdir.

Tanımı anlamaya çalışalım...

(-1,1)

(1,1)

X 1 (1,1), (1,1)

R=?

X 2 (1,1), (1,1)

(-1,-1)

g’leri yazalım

(1,-1)

g1 : a1 x1 b1 x2 c1

g 2 : a2 x1 b2 x2 c2

Bu iki kümenin doğrusal ayrıştırılabilir olduğunu göstermek için ne yapmalıyız?

a1 b1 c1 a2 b2 c2

a1 b1 c1 a2 b2 c2

ve

a1 b1 c1 a2 b2 c2

a1 b1 c1 a2 b2 c2

sağlayan a,b ve c’ler bulunmalı

bir çözüm:

a1 0.5, b1 0, c1 0,

a2 0.5, b2 0, c2 0,

Özellikle, örüntüleri farklı sınıflara

ayıran düzlem olarak kullanılıyor.

Tanım: Karar Düzlemi (Decision Surface) Kümeleri ayıran düzlem.

Tek bir nöron ile neler yapılabilir?

Nöron sayısını artırarak ne yapılabilir ne yapılamaz?

Rosenblatt’ın Genlikte Ayrık Algılayıcısında neler oluyor?

Girişler

Katman1’in çıkışı

j (.)

x Rn

Ne oldu?

n-boyutlu Örüntü uzayı (.) : R

bir vektör (pattern space)

bir örüntüyü

Bu dönüşüm genel

temsil ediyor

olarak doğrusal değil

(pattern)

n

x1

R

yˆ j j ( x)

m

j 1,2,..., m

yˆ R m

yˆ ( x)

( x) ( x) ... ( x)

1

2

m

1 ( x)

m

x2 Genlikte Ayrık Algılayıcı için karar düzlemi: wi y

ˆ i wm1 0

2 ( x)

w1

i 1

w2

??????

Genlikte Ayrık Algılayıcı ancak katman 1’in görüntü uzayındaki

Doğrusal Ayrıştırılabilir

örüntüleri................................................ise

iki sınıfa ayırır.

w

y

m

m

xn

m (x) S1 : wi yˆ i wm1 0

i 1

m

S 2 : wi yˆ i wm1 0

i 1

Soru: Katman 1’de m işlem birimine sahip bir GAA, katman 1

görüntü uzayınındaki P tane örüntüyü 2 sınıfa kaç türlü

Burada işi ne?

ayırabilir?

2P

P m 1

m P 1

Yanıt: L( P, m)

2

P m 1

i 0 i

Hatırlatma:

k

k!

l l!(k l )!

Soru: Herhangi bir doğrusal karar düzleminin GAA ile

hesaplanabilme olasılığı nedir?

1

P m 1

Yanıt: ˆ

L( P, m)

m P 1

PP,m

21 P

P

P m 1

2

i 0 i

1

ˆ

P2( m1),m

2

m büyük bir sayı ise 2(m+1)’den

lim Pˆ( 2 )(m1),m 1

daha az sayıdaki örüntüyü

m

doğru şekilde sınıflayabilir.

lim Pˆ( 2 )(m1),m 0

m

0 < P <2(m+1)

Katman 1 örüntüleri doğrusal ayrıştırılabilecekleri görüntü

uzayına taşır. Doğrusal ayrıştırılamayan örüntüleri doğrusal

ayrıştırılabilir kılmak iki türlü olasıdır: (i) m

(ii) P

XOR Genlikte Ayrık Algılayıcı ile ifade etmek:

(0,1)

(1,1)

P=4, n=2

İki girişli, tek nöronun kapasitesi: 2*3=6

Kapasite açısından uygun ama doğrusal

(1,0) ayrıştırılabilir değiller

(0,0)

m mi P mi

( x1 , x2 ) [( x1 ( x2 1)) ( x2 ( x1 1)) (( x1 1)( x2 1) 1)]

değişti?

(0,1)

(0,1,1)

(1,1)

(1,1,1)

(0,0)

(0,0,0)

(1,0)

(1,0,1)

( x1, x2 ) [( x2 x1x2 0.5) ( x1 x2 x1 0.5) ]

m mi P mi

değişti?

Şimdi Genlikte Ayrık Algılayıcı ile biraz iş yapalım

x1

x2

w2

w1

Verilenler:

y

xm

1

ydk

P

k 1

Eğitim Kümesi

Amaç: İki sınıfa ayırmak

wm

n

wm+1

x ,

k

S1 : wi xi wn1 0

i 1

n

S 2 : wi xi wn1 0

i 1

Gerçeklenebilme Koşulu: Eğitim kümesi doğrusal ayrıştırılabilir

x

Eğitim kümesi doğrusal ayrıştırılabilir ise:

1

Eğitim kümesi doğrusal ayrıştırılabilir değil ise: (x )

1

Öğrenme Kuralı:

x S1

w x0

w(n 1) w(n)

x S2

w x0

w(n 1) w(n)

x S1

w x0

w(n 1) w(n) cx

x S2

T

T

T

öğrenme hızı <1

olan pozitif bir sayı

wT x 0 w(n 1) w(n) cx

1

wi c [ yd y ]xi

2

1

w c [ yd y ]x

2

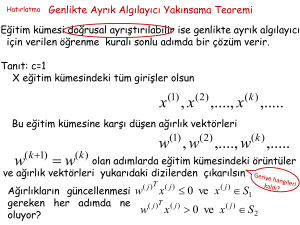

Genlikte Ayrık Algılayıcı Yakınsama Teoremi

Eğitim kümesi doğrusal ayrıştırılabilir ise genlikte ayrık algılayıcı

için verilen öğrenme kuralı sonlu adımda bir çözüm verir.

Tanıt: c=1

X eğitim kümesindeki tüm girişler olsun

(1)

x ,x

( 2)

,...., x

Bu eğitim kümesine karşı düşen ağırlık vektörleri

(1)

( 2)

( k 1)

(k )

,.....

(k )

w , w ,...., w ,.....

w

(k )

olan adımlarda eğitim kümesindeki örüntüler

ve ağırlık vektörleri yukarıdaki dizilerden çıkarılsın

w

( j )T

x 0 ve x S1

Ağırlıkların güncellenmesi w

gereken her adımda ne

( j )T ( j )

( j)

w

x

0

ve

x

S2

oluyor?

( j)

( j)

Güncelleme sırasında neler olacak

w w x

(3)

( 2)

( 2)

(1)

(1)

( 2)

w w x w x x

( 4)

(3)

(3)

(1)

(1)

( 2)

(3)

w w x w x x x

( 2)

( k 1)

w

öğrenme

kuralı

(1)

(1)

w

x

(k )

(k )

w x

(1)

(1)

.... x

(k )

x S1

w x0

w(k 1) w(k ) x

x S2

w x0

w(k 1) w(k ) x

T

T